Поскольку Азия вступает в эпоху глубоких фальсификаций, готова ли она справиться с вмешательством в выборы?

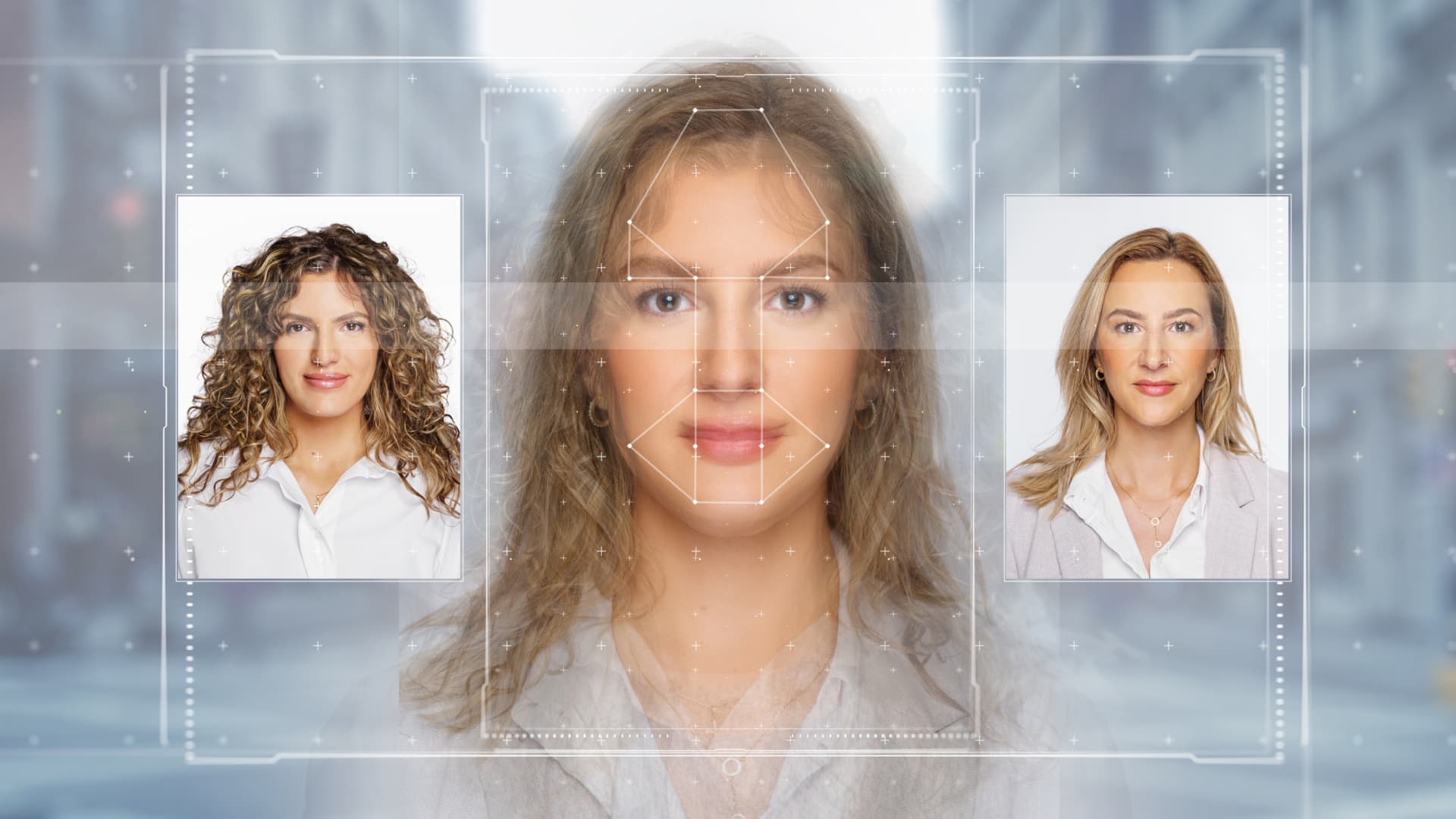

2024 год обещает стать крупнейшим годом глобальных выборов в истории. Это совпадает с быстрым ростом числа глубоких подделок. Согласно отчету Sumsub, только в Азиатско-Тихоокеанском регионе с 2022 по 2023 год количество глубоких подделок выросло на 1530%.

Фотографfielink | Istock | Getty Images

В преддверии выборов в Индонезии, которые состоятся 14 февраля, видео покойного президента Индонезии Сухарто, выступающего в поддержку политической партии, которую он когда-то возглавлял, стало вирусным.

Сгенерированное искусственным интеллектом видео deepfake, в котором были клонированы его лицо и голос, набрало 4,7 миллиона просмотров только на X.

Это не был разовый инцидент.

В Пакистане в связи с общенациональными выборами появилась глубокая фальшивка бывшего премьер-министра Имрана Хана, объявившего, что его партия бойкотирует их. Тем временем в США избиратели из Нью-Гэмпшира услышали откровенную подделку обращения президента Джо Байдена с просьбой не голосовать на президентских праймериз.

Глубокие подделки политиков становятся все более распространенными, особенно с учетом того, что 2024 год должен стать крупнейшим годом глобальных выборов в истории.

Как сообщается, по меньшей мере 60 стран и более четырех миллиардов человек будут голосовать за своих лидеров и представителей в этом году, что вызывает серьезную озабоченность у deepfakes.

Согласно ноябрьскому отчету Sumsub, количество глубоких подделок по всему миру выросло в 10 раз с 2022 по 2023 год. Только в Азиатско-Тихоокеанском регионе количество подделок выросло на 1530% за тот же период.

В онлайн-СМИ, включая социальные платформы и цифровую рекламу, наблюдался наибольший рост числа случаев мошенничества с использованием личных данных – на 274% в период с 2021 по 2023 год. Профессиональные услуги, здравоохранение, транспорт и видеоигры также были среди отраслей, пострадавших от мошенничества с использованием личных данных.

Азия не готова бороться с глубокими фальсификациями на выборах с точки зрения регулирования, технологий и образования, сказал Саймон Честерман, старший директор по управлению ИИ в AI Singapore.

В своем отчете о глобальных угрозах за 2024 год компания по кибербезопасности Crowdstrike сообщила, что, учитывая количество выборов, запланированных на этот год, субъекты национальных государств, в том числе из Китая, России и Ирана, с высокой вероятностью будут проводить дезинформационные кампании, чтобы посеять хаос.

“Более серьезные вмешательства были бы, если бы крупная держава решила, что хочет сорвать выборы в стране — это, вероятно, будет более действенным, чем политические партии, играющие на задворках”, – сказал Честерман.

Хотя у нескольких правительств есть инструменты (для предотвращения онлайн-фальсификаций), существует опасение, что джинн вырвется из бутылки раньше, чем появится время загнать его обратно.

Саймон Честерман

Старший директор AI Сингапур

Однако, по его словам, большинство глубоких подделок по-прежнему будут создаваться субъектами в соответствующих странах.

Кэрол Сун, главный научный сотрудник и глава отдела общества и культуры Института политических исследований в Сингапуре, сказала, что среди внутренних действующих лиц могут быть оппозиционные партии и политические оппоненты, а также крайне правые и левые.

Опасности глубокой подделки

По словам Суна, как минимум, глубокие подделки загрязняют информационную экосистему и затрудняют людям поиск точной информации или формирование обоснованного мнения о партии или кандидате.

По словам Честермана, избирателей также может отпугнуть конкретный кандидат, если они увидят контент о скандальной проблеме, который станет вирусным до того, как его разоблачат как фальшивку. “Хотя у нескольких правительств есть инструменты (для предотвращения онлайн-фальсификаций), проблема в том, что джинн выйдет из бутылки раньше, чем появится время загнать его обратно”.

“Мы видели, как быстро X может быть захвачен глубокой поддельной порнографией с участием Тейлор Свифт — такие вещи могут распространяться невероятно быстро”, – сказал он, добавив, что регулирования часто недостаточно и его невероятно трудно обеспечить. “Часто бывает слишком мало, слишком поздно”.

Адам Мейерс, руководитель отдела операций по борьбе с противником в CrowdStrike, сказал, что глубокие фейки также могут вызывать у людей предвзятое отношение к подтверждению: “Даже если в глубине души они знают, что это неправда, если это то сообщение, которое они хотят, и то, во что они хотят верить, они не собираются от этого отказываться”.

Честерман также сказал, что поддельные кадры, на которых показаны неправомерные действия во время выборов, такие как вброс бюллетеней, могут заставить людей потерять веру в законность выборов.

С другой стороны, кандидаты могут отрицать правду о себе, которая может быть негативной или нелестной, и вместо этого приписывать это глубоким подделкам, сказал Сун.

Кто должен нести ответственность?

По словам Честермана, сейчас пришло осознание того, что платформы социальных сетей должны брать на себя больше ответственности из-за той квазиобщественной роли, которую они играют.

В феврале 20 ведущих технологических компаний, включая Microsoft, Meta, Google, Amazon, IBM, а также стартап по искусственному интеллекту OpenAI и компании социальных сетей, такие как Snap, TikTok и X, объявили о совместном обязательстве бороться с использованием искусственного интеллекта для обмана на выборах в этом году.

Подписанное технологическое соглашение является важным первым шагом, заявила Сун, но его эффективность будет зависеть от реализации и правоприменения. Поскольку технологические компании принимают различные меры на своих платформах, необходим многосторонний подход, сказала она.

Вскоре добавится, что технологические компании также должны будут быть очень прозрачными в отношении того, какие решения принимаются, например, какие процессы внедряются.

Но Честерман сказал, что также неразумно ожидать, что частные компании будут выполнять то, что по сути является государственными функциями. Решение о том, какой контент разрешать в социальных сетях, – непростая задача, и компаниям могут потребоваться месяцы, чтобы принять решение, сказал он.

“Мы не должны просто полагаться на добрые намерения этих компаний”, – добавил Честерман. “Вот почему необходимо установить правила и установить ожидания для этих компаний”.

С этой целью некоммерческая организация Coalition for Content Provenance and Authenticity (C2PA) ввела цифровые учетные данные для контента, которые будут показывать зрителям проверенную информацию, такую как информация об авторе, где и когда он был создан, а также использовался ли генеративный искусственный интеллект для создания материала.

Среди компаний-членов C2PA – Adobe, Microsoft, Google и Intel.

OpenAI объявила, что в начале этого года будет внедрять учетные данные контента C2PA для изображений, созданных с помощью своего предложения DALL· E 3.

“Я думаю, было бы ужасно, если бы я сказал: “О да, я не волнуюсь. Я чувствую себя великолепно’. Типа, в этом году нам придется следить за этим относительно внимательно [with] сверхпрочный мониторинг [and] очень плотная обратная связь.”

В интервью Bloomberg House на Всемирном экономическом форуме в январе основатель и генеральный директор OpenAI Сэм Альтман сказал, что компания “полностью сосредоточена” на том, чтобы ее технология не использовалась для манипулирования выборами.

“Я думаю, что наша роль сильно отличается от роли платформы распространения”, такой как сайт социальных сетей или новостной издатель, сказал он. “Мы должны работать с ними, так что это похоже на то, что вы создаете здесь и распространяете здесь. И между ними должен быть хороший разговор”.

Мейерс предложил создать двухпартийную некоммерческую техническую организацию с единственной миссией анализа и выявления глубоких подделок.

“Затем общественность может отправлять им контент, который, как они подозревают, подвергается манипуляциям”, – сказал он. “Это не надежно, но, по крайней мере, есть какой-то механизм, на который люди могут положиться”.

Но в конечном счете, хотя технология является частью решения, большая ее часть зависит от потребителей, которые все еще не готовы, сказал Честерман.

Сун также подчеркнул важность просвещения общественности.

“Нам необходимо продолжать информационно-разъяснительную работу и вовлечение общественности, чтобы усилить чувство бдительности и осознанности, когда общественность сталкивается с информацией”, – сказала она.

Общественность должна быть более бдительной; помимо проверки фактов, когда что-то вызывает серьезные подозрения, пользователям также необходимо проверять важные фрагменты информации, особенно перед тем, как делиться ею с другими, сказала она.

“Каждому найдется чем заняться”, – сказал Сун. “Все в сборе”.

— Маккензи Сигалос из CNBC и Райан Браун внесли свой вклад в этот отчет.